Erreurs d'une RLS et leur variance

Comment se servir de résidus pour estimer la variance des erreurs : vous l’avez deviné, cette page n’est pas la plus glamour du web. Mais si vous faites des études de statistiques, vous devez comprendre ce qu’il y a sous le capot d’une régression !

Erreurs

Dans sa version déterministe, une régression linéaire simple (RLS) se traduit par une équation de droite, soit \(y = ax + b,\) avec \(x\) variable explicative (numérique), \(y\) variable expliquée, \(a\) et \(b\) deux paramètres à estimer. Tous les détails en page de droite des moindres carrés.

Or, une liaison fonctionnelle est rarement déterministe. Il existe une part d’aléa, expression des différences individuelles. On l’appelle erreur. Par exemple, on peut vouloir connaître la taille d’un animal à partir de ses empreintes, mais deux empreintes de même mesure peuvent avoir été laissées par deux animaux de tailles différentes. Le modèle que l’on souhaite obtenir est « stochastique ».

Chaque observation peut donc être décomposée en une partie expliquée par le modèle déterministe et une autre, aléatoire, notée avec la lettre grecque epsilon. Soit \(\varepsilon_i.\)

- On suppose que les variables aléatoires (v.a) \(\varepsilon_i\) suivent une loi normale d’espérance nulle et de même variance \(\sigma^2\) (homoscédasticité).

- On suppose aussi qu’elles ne sont pas corrélées entre elles (ce qui n’est pas toujours vérifié dans les séries chronologiques !).

Par ailleurs, chaque valeur \(y_i\) est une v.a puisqu’elle inclut une v.a.

Partant de là, les vraies valeurs de \(a\) et \(b\) ne peuvent pas être connues. Nous devons les estimer de façon à minimiser la somme des carrés des erreurs.

Ainsi, les estimateurs \(a\) et \(b\) sont deux variables aléatoires. On les note avec des « chapeaux » : \(\widehat{a}\) et \(\widehat{b}.\) Leurs espérances sont \(a\) et \(b\) (voir les estimateurs d’un modèle de RLS).

Pour résumer, le modèle linéaire stochastique intègre trois v.a (et évidemment davantage dans le cas d’une régression multiple) : le coefficient de régression \(\widehat{a},\) la constante \(\widehat{b}\) et \(\sigma^2,\) estimation de la variance des erreurs.

Le modèle linéaire n’est certainement pas idéal. Il est d’ailleurs rare qu’il représente une parfaite relation entre deux grandeurs, dans quelque domaine que ce soit. Pour une observation donnée, on appelle résidu (noté \(e\)) la différence entre la réalité et la valeur donnée par le modèle. Mais pour ne pas être bloqué dans une impasse, nous considérerons que le modèle est correct.

Variance des erreurs

Évidemment, on ne connaît pas les erreurs. Alors par quelle magie peut-on déterminer leur variance ?

Comme nous admettons que le modèle linéaire est bien celui qui devait être choisi, nous travaillons à partir des résidus. Ils s’expriment ainsi : \(e_i = y_i - \widehat{y}_i.\) La variance des erreurs est donc estimée par celle des résidus.

Un estimateur sans biais de la variance des erreurs s’appuie sur la formule de la variance :

\(\displaystyle{s^2 = \frac{\sum{(y_i - \widehat{y}_i)^2}}{n-2}}\)

Remarquez que le dénominateur est \(n-2\) et non \(n-1.\) En effet, on divise par le nombre d’observations \(n\) moins celui de paramètres estimés, en l’occurrence \(\widehat{a}\) et \(\widehat{b}.\) C’est le nombre de degrés de liberté (ddl) qui est, rappelons-le, le nombre d’observations indépendantes après avoir pris en compte les contraintes imposées par les estimations des paramètres.

Souvent, les logiciels ne fournissent pas la variance des erreurs mais leur écart-type.

Exemple

Nous reprenons ci-dessous les données utilisées pour la RLS avec Excel. Le directeur de l’hôtel club « Variance bleue » étudie la relation entre le nombre de transats mis à la disposition de ses clients et les recettes du bar.

| Date | Transats | Recette | Recette théorique | \(e_i^2\) |

| 01 août | 17 | 255 | 256,11 | 1,2321 |

| 02 août | 19 | 280 | 284,25 | 18,0625 |

| 03 août | 18 | 274 | 270,18 | 14,5924 |

| 04 août | 20 | 289 | 298,32 | 86,8624 |

| 05 août | 22 | 336 | 326,46 | 91,0116 |

| 06 août | 25 | 364 | 368,67 | 21,8089 |

| 07 août | 19 | 285 | 284,25 | 0,5625 |

| 08 août | 16 | 245 | 242,04 | 8,7616 |

| 09 août | 24 | 360 | 354,60 | 29,1600 |

| 10 août | 23 | 341 | 340,53 | 0,2209 |

| 11 août | 21 | 316 | 312,39 | 13,0321 |

| 12 août | 17 | 280 | 256,11 | 570,7321 |

| 13 août | 18 | 240 | 270,18 | 910,8324 |

| 14 août | 20 | 297 | 298,32 | 1,7424 |

| 15 août | 24 | 355 | 354,60 | 0,1600 |

La deuxième colonne est celle de la variable explicative \(x.\) La troisième est celle de la variable à expliquer \(y.\) Ces données nous conduisent à établir le modèle de régression suivant : \(y = 14,07x + 16,92.\) Cette équation fournit la recette à laquelle le directeur peut s’attendre avec ce modèle. Mais celui-ci n’est pas déterministe : le cas ne s’est pas produit mais on pourrait tout à fait constater deux fois le même nombre de transats mais associé à des recettes différentes.

Les erreurs \(\varepsilon_i\) sont la différence entre les colonnes 3 et 4. Nous avons vu qu’on les estimait avec les résidus qui apparaissent dans la dernière colonne. Ici, ils sont directement élevés au carré.

La somme des résidus au carré vaut 1 768,774. Si l’on divise cette valeur par le nombre de ddl, c’est-à-dire 13, on obtient 136,06. C’est l’estimation de \(\sigma^2.\)

La racine carrée de ce nombre vaut 11,664. C’est l’estimation de l’écart-type des erreurs (RMSE) ou erreur type.

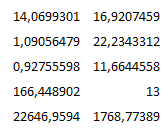

Les valeurs ci-dessous sont obtenues avec la fonction DROITEREG d'Excel (voir la RLS avec Excel pour un mode d'emploi détaillé). L'écart-type des erreurs apparaît sur la troisième ligne.

Ce même exemple est repris en page de programmation d'une RLS. Vous pourrez retrouver ces résultats grâce à R et à Python (plus précisément la bibliothèque pandas de Python).